スターレス画像で背景がフラットに

注文していたAskar Color Magicフィルターが届きました。6nmのデュアルナローバンドフィルターでD1がHaとOIII、D2がSIIとOIIIの2枚組です。これまでのIDAS NBZの通過帯域が半分になること、SIIがカラーカメラで捉えられることから、解像度の高い、本当のSHO画像が作れると期待しているのですが、撮影の機会がありません。

暇ですので、これまで疑問に思っていたローカルノーマライゼーションについて調べてみました。最近はPixInsightのWBPPにおまかせして、Local Normalization(LN)のレファレンスファイルを作ってもらっています。そうすると、異なる撮影日のデータから、SN比の高いサブフレームが選ばれます。撮影日が異なると、背景の勾配も異なるはずですので、これで本当に大丈夫なのか不思議に思っていたのです。

一番SN比の良い1枚のサブフレームを使って、それに背景を合わせるNormalize Scale Gradient(NSG)というスクリプトがあることを、丹羽さんのサイト(https://masahiko.me/nsg/)で知りました。新しいアルゴリズムを使っており、特に撮影日が複数の場合が効果的とのことですので、これまでに撮影したカリフォルニア星雲で試してみました。

Normalize Scale Gradient(NSG)スクリプト

NSGにはフリー版と有料版があるようですが、無料版を試してみました。WBPPでは、パイプラインタブでイメージインテグレーションだけを有効にして、他の機能をオフにします。

無効 Subframe Weighting (NSGが行う)

有効 Image Registration

無効 Local Normalization (NSGの主な機能)

無効 Image Integration (NSGの後で自動的に起動)

WBPPの実行の後で、NSGを起動します。レジストレーション済みの画像をターゲットとして読み込み、単純にNoiseレベルの最も低い画像をレファレンスにして、実行します。

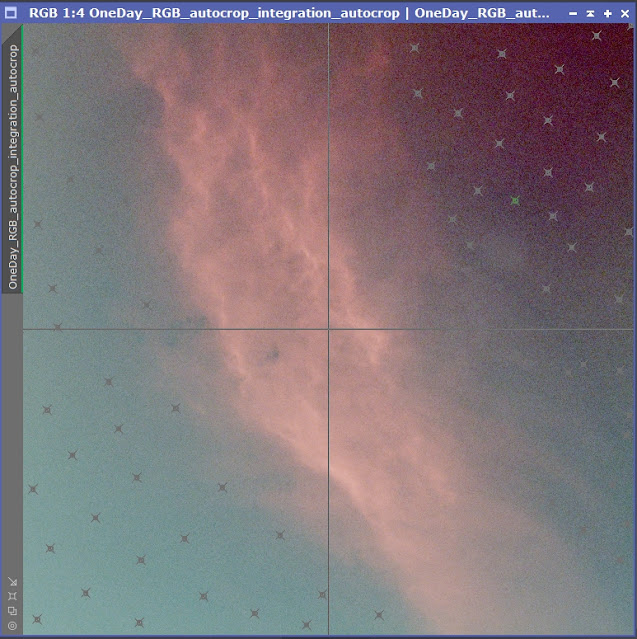

この後にインテグレーションし、ABEを使って背景ムラを均一にした強調ストレッチ画像です。

都内の光害地だとこんなもんでしょうか。それほど効果的に背景が均一になるわけではないようです。

標準のLNとの比較

WBPPで標準のLNを使ってインテグレーションし、同じ条件で背景ムラを取って強調ストレッチした画像と比較してみます。

どうでしょうか。多少NSGの方が良いかなという程度のように思えます。作業手順が面倒になる割には、効果のほどは・・・という感じです。

LNのレファレンスを同じ日のフレームに限る

寝てる間に気付いたことがあります。LNのレファレンスを作るときに、インタラクティブモードにし、同じ日のサブフレームだけから、ノイズの低いものを選んだらどうかということです。NSGのように1枚だけを選ぶのではないし、背景の勾配も似ているはずですから、この方法が一番優れているのではと思った次第です。次のように、枚数を8枚程度と少なくし、同じ日付のものだけをLNのレファレンスにします。

これでローカルノーマライゼーションして、インテグレーションした画像です。

予想に反して、これまでのLNとほとんど変わりません。もしかしたら左下あたりは、多少ムラが減っているような気がしないでもないのですが・・・

LNのレファレンスをフラットなのだが

LNのレファレンスそのものは、背景が極めてフラットです。同じようにABEで背景ムラを取った画像です。

このレファレンス画像でローカルノーマライゼーションしているのに、どうして背景ムラができてしまうのでしょう?

ABEではなくDBEにしてみる

ABEに代えてDBEを使ってみます。次のように強調ストレッチした状態で、星雲と星を避けてポイントしていきます。

これで背景ムラを取った画像ですが、結果はABEとそれほど変わらないどころか、かえって悪くなっているような気がします。DBEのパラメーターを変えても、大きな違いはありません。

ステーレス画像でDBEを行う

ここであきめていたところ、Adam Blockさんの次の動画に目が止まりました。ノイズのひどい画像の処理方法に関するものでした。

|

スターレス画像を作り、それに対してDBEで背景ムラを取り、その後で星画像を戻すという単純な方法です。早速試してみました。次のようにスターレス画像を作り、さきほどと同じ条件でDBEをかけます。

こうして作った背景ムラを取ったスターレス画像に、星画像を合成します。なんと、これまでで一番良い結果になりました。

さらに、BlurXTerminatorをかけてSPCCでカラーキャリブレーションし、強調ストレッチしたのが次の画像です。どうも良さそうです。

これから

まだこの後の処理はしていませんが、この方法が優れていることが、一目瞭然のように思えます。処理を続けるとともに、他の対象に対しても試してみようと思います。これまでどおりのWBPPが使えますし、DBEのポイントを打つときに星がないので、断然楽です。

しかし、いずれAIを使ったGradientXTerminatorが出てくるようですので、それまでのつなぎかもしれませんが・・・

Color Magicフィルターを使った撮影を楽しみにしています。また、下手なりに、内部に植毛紙を貼ったガイド鏡と主鏡の遮光フードも作りましたので、その効果も検証してみようと思います。

※追記(2022/2/26)

コメント

コメントを投稿

コメントはこちら